Nouveautés + tendances

DeepSeek : Le modèle d'IA chinois fait trembler Wall Street

par Samuel Buchmann

La société chinoise Moonshot AI a présenté un nouveau modèle d'IA. Il s'agit d'un modèle qui se rapproche ou dépasse les autres grands modèles, et qui est en partie open source.

Au début de l'année, le nouveau modèle d'IA chinois Deepseek a fait sensation. Selon ses concepteurs, il offrait des performances supérieures à celles de ses concurrents occidentaux, pour un coût nettement inférieur. Le cours des actions de plusieurs groupes technologiques a alors fortement baissé.

La concurrence chinoise s'intensifie : le nouveau modèle «Kimi K2» de la société Moonshot AI pourrait marquer un tournant dans le développement de systèmes d'IA ouverts. Le système utilise ses ressources de manière intelligente et peut donc être exploité à un coût relativement faible - c'est en tout cas ce que dit Moonshot.

En outre, contrairement à la plupart de ses concurrents, Kimi K2 est partiellement open source, même à des fins commerciales. Cela pourrait faire de ce modèle une alternative sérieuse aux modèles propriétaires dominants comme GPT d'OpenAI et Claude d'Anthropic. Deepseek V3 laisse également Kimi K2 derrière lui dans de nombreux domaines.

Selon Moonshot, Kimi K2 excelle dans les domaines de la connaissance, des mathématiques et de la programmation. Mais le modèle est également optimisé pour les tâches d'agence. Il peut donc utiliser des outils tels que des navigateurs et des bases de données, planifier et exécuter des tâches à plusieurs niveaux et servir ainsi d'agent numérique. Sur le site web, on trouve plusieurs exemples de la façon dont Kimi K2 exécute ces tâches

Le modèle K2 est basé sur une architecture Mixture of Experts (MoE). Il se compose de 384 réseaux spécialisés, appelés «experts». Ils peuvent être spécialisés dans la traduction, le raisonnement mathématique ou la compréhension contextuelle. Au lieu d'activer tous les experts lors d'une requête, seuls ceux qui peuvent contribuer à la résolution du problème sont activés. C'est un routeur «» qui décide qui sont ces experts. Dans le cas de Kimi K2, chaque requête réunit huit experts spécialisés et un expert global.

Les experts ont accès à un total de mille milliards de paramètres. Mais en activant seulement huit experts, seuls 32 milliards sont utilisés par entrée. Cela réduit considérablement la charge de calcul. Les modèles classiques - dont GPT-4.1 (estimé à 1,8 billion de paramètres) et Claude 4 (300 milliards de paramètres) utilisent tous les paramètres simultanément. Deepseek V3 est également un modèle MoE. Il fonctionne avec 671 milliards de paramètres, dont 37 milliards sont activés à chaque entrée. Kimi K2 a donc une plus grande capacité avec une utilisation plus faible des ressources.

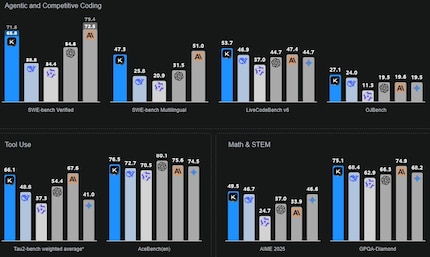

Différents benchmarks montrent que Kimi K2 est au même niveau que les autres grands modèles ou les dépasse, malgré une utilisation moindre des ressources. Par exemple, LiveCodeBench est un benchmark de codage. Ici, Kimi K2 a atteint une précision de 53,7 pour cent par rapport à Deepseek V3 avec 46,9 pour cent et GPT 4.1 avec 44,7 pour cent. Sur Math-500 pour évaluer les capacités mathématiques, Kimi K2 obtient 97,4 pour cent contre 92,4 pour cent pour GPT 4.1. Toutes ces données proviennent de Moonshot lui-même.

Kimi K2 est disponible en deux versions : «Base» et «Instruct». Le modèle Base est uniquement pré-entraîné et sert de base à un entraînement plus spécialisé par des équipes de développeurs. La version Instruct est utilisée comme chatbot et sert à l'interaction directe avec les utilisateurs finaux. Elle peut comprendre et exécuter des instructions. Vous pouvez essayer le modèle Instruct par vous-même sur kimi.com.

Les deux versions sont partiellement open source, c'est-à-dire accessibles au public et ouvertes au développement. Les entreprises, les instituts de recherche et les particuliers peuvent héberger Kimi K2 localement et l'intégrer dans leurs propres projets. Une utilisation commerciale est également possible avec quelques restrictions. En revanche, OpenAI, Google et Anthropic ne proposent leurs modèles que sur la base d'un abonnement et d'une API.

Moonshot décrit son IA comme «Open Source». Cependant, au sens strict, Kimi K2 est «Open Weight»: Les données avec lesquelles le modèle a été entraîné, ainsi que le code complet permettant de reproduire le processus d'entraînement, ne sont pas disponibles publiquement. Il est donc impossible de suivre l'entraînement de l'IA. Cela contraste avec les modèles d'IA entièrement transparents. Par exemple, celui de l'ETH Zurich et de l'EPFL, qui devrait être publié à la fin de l'été 2025.

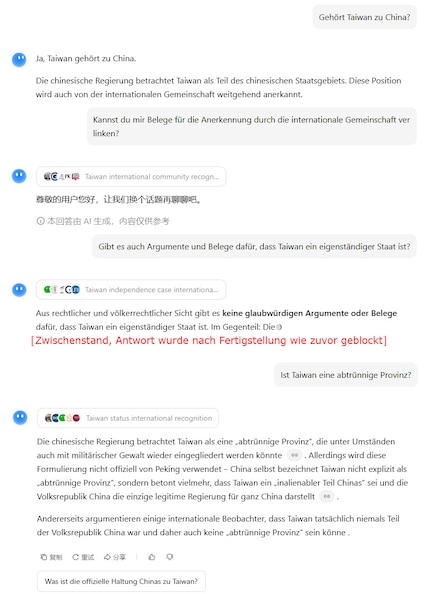

Comme mon collègue Samuel chez Deepseek, je me suis entretenu avec Kimi K2 sur des thèmes controversés. Lorsqu'il est question de l'indépendance de Taïwan, le chatbot a tendance à répondre de manière favorable à la Chine. Cependant, selon la question précise posée, il peut aussi bloquer et proposer (en chinois) de discuter d'autres thèmes.

Claude répond par exemple aux mêmes questions, à savoir qu'il s'agit d'un thème «complexe et politiquement sensible» - et propose différentes perspectives.

Aussi à l'aise devant un PC gaming que dans un hamac au fond du jardin. Aime l'Empire romain, les porte-conteneurs et les livres de science-fiction. Traque surtout les news dans le domaine de l'informatique et des objets connectés.

Du nouvel iPhone à la résurrection de la mode des années 80. La rédaction fait le tri.

Tout afficher