Une question de taille: l’histoire du disque dur

Dans le domaine de l'informatique, le stockage des données est d'une importance capitale. Dans la vie de tous les jours, on l’oublie souvent parce que cela va de soi. Pourtant, le disque dur a révolutionné l'utilisation des ordinateurs: coup de projecteur sur l’histoire des cartes perforées, des plateaux et de nombreux autres formats.

Enfant dans les années 80 et 90, j’entends encore résonner dans ma tête les grésillements si caractéristiques du démarrage du disque dur, ce que les PC et portables actuels dotés d’une SSD ne font plus. À l’époque, c’était une vraie cacophonie; aujourd’hui, en les écoutant, on retombe d’emblée en enfance. Et quelque part, ils étaient rassurant, car je savais alors que ça tournait. Mais avec un SSD, je n’ai plus ce plaisir.

Pour les nostalgiques: un PC des années 90 au démarrage

Dans mon travail quotidien, j’oublierais presque l’existence du disque dur de mon portable. La mémoire de masse a ouvert la voie au PC. Avant son avènement, les données étaient principalement stockées sur des cartes perforées, inventées par l’Américain Herman Hollerith.

À la conquête du monde avec des trous

Herman Hollerith travaille au dépouillement du recensement de 1880, au cours duquel il est confronté au problème de l’exploitation des données. Les dispositifs auxiliaires mécaniques de cette époque atteignent leurs limites en raison de l'énorme quantité de papier générée. Il aura fallu huit ans pour disposer de l’intégralité des résultats. Pour relever ce défi de taille, il met au point un système de cartes perforées, pour lequel il dépose le brevet en 1889.

Saviez-vous que ce type de systèmes de cartes perforées existait déjà avant Hollerith? Mais le sien, conçu au départ pour stocker des données, se compose d'un perforateur, d'un lecteur avec tabulateur et d'un trieur. Le premier perfore les données sur la carte. Le second balaie la carte perforée et transmet, par le biais d'impulsions électriques, les données aux compteurs du tabulateur. Le trieur forme des piles selon certains critères. La machine Hollerith peut être programmée de manière limitée avec des cadres interchangeables. Grâce à ce procédé, on pouvait définir sur le tabulateur le traitement du contenu de la carte.

Source : Heinz Nixdorf MuseumsForum (HNF)

Grâce au système de Hollerith, le recensement de 1890 prend un peu moins de temps. Après trois mois, on peut déjà présenter les premières données et, six mois plus tard, terminer le comptage. À l’issue de ses études d'ingénieur minier, il fonde sa propre entreprise, laquelle, plus tard, est rachetée puis rebaptisée IBM.

En 1928, la carte perforée adopte un format standardisé. Voici grosso modo son fonctionnement: sur cette carte, on perce des trous qui représentent des caractères codés. Elle n’en comporte qu’un certain nombre uniquement. Plusieurs cartes sont donc nécessaires pour des données/applications plus importantes. Ces cartes perforées plus modernes ont une capacité de 80 octets.

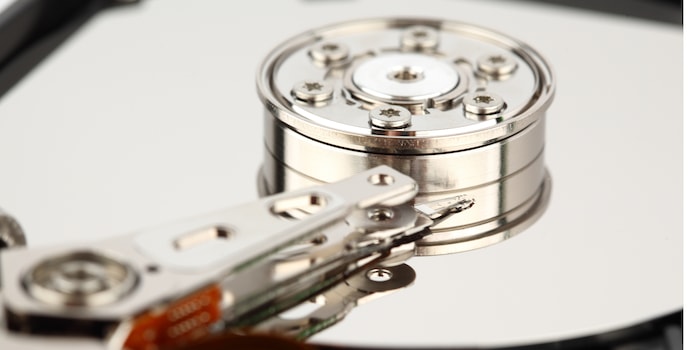

Premiers HDD

Source : Wikipedia

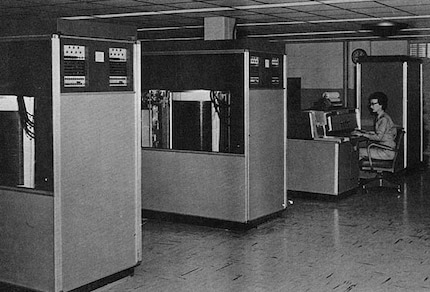

Le système de cartes perforées ayant atteint ses limites, une nouvelle solution de stockage de masse doit voir le jour. C’est alors que le disque dur fait son apparition. En 1956, IBM lance le 305 RAMAC: cette machine renferme un disque dur d’une capacité de 5 Mo, qui utilise 50 plateaux de 24 pouces de diamètre magnétisables des deux côtés. Elle prend beaucoup de place: d’une tonne environ, elle mesure 1,70 m x 1,50 m x 75 cm. Devant de telles dimensions, on doit utiliser des camions et des chariots pour la livraison des disques durs.

Le mode de fonction du premier disque est déjà semblable à celui d’aujourd’hui. Recouverts des deux côtés d'une couche magnétique, les plateaux en aluminium, tournant à 1200 tr/min, sont empilés les uns sur les autres en laissant un écart de huit millimètres. Cette machine est dotée de deux bras de lecture-écriture; le premier, pour sélectionner le plateau, et le second, pour se positionner sur le bon secteur.

Avancées

L'IBM 1301 constitue une étape successive de grande envergure. Le modèle de 1961 dispose d’une tête de lecture-écriture pour chacun des 25 plateaux qui tournent à 1800 tr/min. Avec 26 000 octets par pouce, il offre alors 13 fois la capacité de mémoire du RAMAC. Un an plus tard, le 1311, le successeur de l'IBM 1301, débarque sur le marché. Sa mémoire de masse devient quelque peu mobile: on peut en effet remplacer les six plateaux de 14 pouces. Un empilement de plateaux, d’un poids de 4,5 kg seulement, offre une capacité de stockage de 2,6 Mo de données.

Source : computerhistory.org

Grâce au système de stockage IBM 3340, rebaptisé «Winchester», diverses innovations sont alors introduites. Aujourd'hui encore, tous les lecteurs de disques à boîtier scellé – lecteurs dont la mécanique est protégée contre les influences de l’environnement – sont désignés de la sorte. L'origine de ce nom, assez méconnue finalement, viendrait d’un modèle de carabine, la Winchester 30-30, qui rappelle le partitionnement de la mémoire de 30 Mo et 30 Mo (bien que cela ne soit pas correct). Autre raison possible? Ce disque a été produit à Winchester. Les plateaux sont installés dans des modules amovibles. Les têtes de lecture-écriture sont fixes et donc plus petites et plus légères que leurs prédécesseurs. Cette technologie permet d’augmenter massivement la capacité de stockage, les tolérances de réglage de la tête entre les disques et les différents modules étant éliminées. La capacité de mémoire est de 35 Mo ou 70 Mo, selon le module. En 1980, IBM atteint une capacité de stockage de ses systèmes de 2,52 Go.

Mémoire de masse pour PC et portables

Jusqu'aux années 1970, les ordinateurs sont d'énormes appareils utilisés principalement dans les entreprises, les universités et les autres institutions. Mais au fil des ans, les prix des composants électroniques baissent, ouvrant alors la voie à de nouveaux marchés de vente. Les ordinateurs sont également de plus en plus utilisés dans le secteur privé. C’est la possibilité de stocker des données sur un support qui est à l’origine de ce développement. La jeune startup d’alors, Seagate, apporte une énorme pierre à l’édifice. Elle développe un disque dur de 5,25 pouces d’une capacité de stockage de 5 Mo, et ce, pour la modique somme de 1500 dollars de l'époque. Le Seagate ST-506 permet de stocker le système d'exploitation, les logiciels et les données sur un seul support. Il n’est donc plus nécessaire d'insérer une disquette pour chacune de ces tâches.

Source : computerhistory.org

Par la suite, la capacité de stockage augmente et les disques durs rapetissent. En 1991, Toshiba lance un disque dur de 2,5 pouces. Aujourd'hui, on en trouve essentiellement à 3,5 ou 2,5 pouces. À première vue, ce sont surtout les interfaces qui changent: IDE, SCSI, ATA, SATA, PCIe. À chaque nouvelle interface, le transfert des données est plus rapide et plus fiable. Les vitesses de rotation des plateaux augmentent, à l’instar des performances. La capacité de stockage est boostée, entre autres, par un plus grand nombre de plateaux dans le même espace (plateau vitrocéramique au lieu du plateau en aluminium, conception plus fine possible) et par un nouveau processus d'écriture: au début, Longitudinal Recording (LTR, enregistrement longitudinal), puis Perpendicular Magnetic Recording (PMR, enregistrement magnétique perpendiculaire) et enfin Shingled Magnetic Recording (SMR, enregistrement magnétique en bardeaux). Grâce à la technologie SMR et au remplissage à l'hélium au lieu de l'air, il est actuellement possible de fabriquer des disques durs de 14 To.

HDD contre SSD

La disparition des disques durs est décriée depuis que les disques SSD à capacité de mémoire plus raisonnable sont devenus abordables. Bien que la technologie SSD soit presque aussi ancienne que celle du HD, elle ne devient une concurrente économique qu'avec l'avènement des SSD flash. À l’heure actuelle, les HDD offrent plus de stockage pour moins cher. Cependant, les SSD ont déjà plus de capacité de stockage. Bientôt, on commercialisera des modèles de 100 To. Pour le consommateur lambda cependant, il est probable qu'ils restent inabordables pendant un certain temps (les prix se situant dans une fourchette à cinq chiffres). L'augmentation constante des capacités de stockage des disques SSD permettra encore d’en réduire le prix. L’écart tarifaire par Go entre le HDD et le SSD se réduira de plus en plus à l'avenir.

Comme les HDD offrent plus de capacité de stockage pour les dépenses encourues, ils conviennent pour le moment bien mieux aux serveurs/NAS. Le stockage en réseau NAS dépend principalement de la vitesse de la technologie de connexion. Dans un réseau de 1 Gbit, la vitesse d'un SSD se perd pendant la transmission. Il faudrait un réseau de 10 Gbit pour qu'un SSD sur NAS fasse sens.

L’avenir du disque dur

Les besoins en mémoire sont actuellement si importants qu'ils ne peuvent pas être couverts par les SSD uniquement. En sept ans, seuls dix pour cent de la demande mondiale seront couverts par la mémoire flash. On utilisera encore les disques durs, mais il faudra en augmenter la capacité de stockage. Pour ce faire, on pourra recourir à une méthode simple: des boîtiers plus hauts capables d’en contenir davantage. En plus de cette augmentation relativement simple de la capacité, on mène également des recherches sur de nouvelles technologies de disques durs.

Deux d'entre elles, prometteuses, sont en passe d’être commercialisées: Western Digital travaille sur MAMR et Seagate, sur HAMR. la technologie Heat Assisted Magnetic Recording consiste à utiliser un laser thermique qui chauffe brièvement le substrat magnétique à écrire. La température revient à la normale une fois cette opération effectuée. Grâce à cette technique du chauffage, l’écriture nécessite une intensité de champ plus faible. De ce fait, les têtes sont un peu plus minces, les pistes aussi: autrement dit, il y a plus de place pour écrire sur un même espace. Microwave Assisted Magnetic Recording va dans la même direction. Cette technologie utilisera quant à elle une tête d’impression dotée d’un émetteur micro-ondes. Elle nécessite moins d'intensité de champ magnétique pour magnétiser le substrat.

Les nouvelles technologies devraient permettre de créer des disques durs de 100 To. Selon les prévisions actuelles, elles devraient débarquer d’ici à 2025. Le disque dur a encore de beaux jours devant lui, tout du moins tant que les HDD offriront plus de capacité et seront moins chers que les SSD.

La technologie et la société me fascinent. Combiner les deux et les regarder sous différents angles est ma passion.

Des informations intéressantes sur le monde des produits, un aperçu des coulisses des fabricants et des portraits de personnalités intéressantes.

Tout afficher